Директива Crawl-delay – это правило, установленное в файле robots.txt, которое регулирует скорость сканирования веб-страниц роботами поисковых систем. Она позволяет веб-мастерам ограничить количество запросов от поисковых роботов в единицу времени, чтобы избежать перегрузки сервера и проблем с доступностью сайта.

Параметр crawl-delay указывает задержку между запросами, выраженную в секундах. Например, значение crawl-delay: 5 означает, что робот должен ждать 5 секунд между запросами. Это позволяет распределить нагрузку на сервер и снизить риск блокировки доступа к сайту. Директива crawl-delay обычно применяется на сайтах с большим объемом контента или на серверах с низкой производительностью.

Директива crawl-delay имеет значение только для поисковых роботов, которые уважают правила файла robots.txt. Некоторые роботы игнорируют это правило, и их скорость сканирования будет неограниченной. Однако большинство поисковых систем, таких как Google, Yandex и Bing, учитывают параметр crawl-delay и следуют указанной задержке между запросами.

Раздел 1: Основные понятия

Директива Crawl-delay определяет задержку между запросами, которые робот отправляет на сайт. Это позволяет снизить нагрузку на сервер и поддерживать баланс между скорость обхода и эффективностью работы робота. Значение параметра crawl-delay указывается в секундах.

Если значение параметра равно 0, то роботу не устанавливается никакая задержка, и он отправляет запросы на сайт без ограничений. В случае, если значение параметра больше 0, то робот будет следовать установленной задержке перед каждым новым запросом. Например, если crawl-delay равно 5, то робот будет ждать 5 секунд перед отправкой следующего запроса.

Преимущества и недостатки использования директивы Crawl-delay

Директива Crawl-delay в файле robots.txt позволяет веб-мастерам контролировать скорость обхода и индексации сайта поисковыми роботами. Это полезное средство для оптимизации процесса обхода и индексации страниц сайта, которое имеет свои преимущества и недостатки.

Преимущества:

- Контроль скорости индексации. С помощью директивы Crawl-delay можно установить оптимальную скорость обхода и индексации сайта, что позволит не перегружать сервер и предотвратить проблемы с доступностью сайта для пользователей.

- Защита от некорректной индексации. Некоторые сайты могут содержать большое количество динамических или генерируемых на лету страниц, которые не нужно индексировать. Установка Crawl-delay позволяет предотвратить индексацию таких страниц и сосредоточиться на важных контенте сайта.

- Учет особенностей сайта. С помощью директивы Crawl-delay можно установить разную скорость обхода для различных разделов или подразделов сайта, что учитывает их важность или специфику.

Недостатки:

- Ограничение доступа к контенту. Использование Crawl-delay может ограничивать доступ к свежему контенту сайта, так как обход и индексация может занимать больше времени.

- Зависимость от роботов поисковых систем. Роботы поисковых систем могут не всегда соблюдать указанное значение Crawl-delay, что может привести к некорректной индексации сайта.

- Потеря конкурентных преимуществ. В некоторых случаях использование Crawl-delay может привести к тому, что конкуренты получат преимущество в виде более быстрой и активной индексации своих страниц.

Раздел 3: Практическое применение директивы Crawl-delay

В предыдущих разделах мы рассмотрели, что такое директива Crawl-delay и как она может быть использована для управления скоростью обхода веб-краулером. В этом разделе мы рассмотрим практическое применение данной директивы и дадим несколько советов по ее использованию.

Применение директивы Crawl-delay

Директива Crawl-delay может быть полезна в следующих случаях:

- Сайт имеет большое количество страниц и небольшую пропускную способность сервера. В этом случае установка значений crawl-delay может предотвратить перегрузку сервера и улучшить производительность сайта.

- Сайт содержит чувствительную информацию, которую необходимо защитить от скраперов. Установка crawl-delay может затруднить обнаружение данных и уменьшить вероятность несанкционированного доступа к ним.

- Сайт хочет управлять скоростью обхода краулера для определенных категорий страниц. Например, сайт может разрешить более быстрый обход главной страницы, но установить задержку для обхода страниц с обратной связью или обработкой данных.

Советы по использованию директивы Crawl-delay

- Определение оптимального значения crawl-delay: Для каждого сайта оптимальное значение crawl-delay может быть разным. Тестирование и сбор статистики об обходе сайта могут помочь определить наиболее эффективное значение.

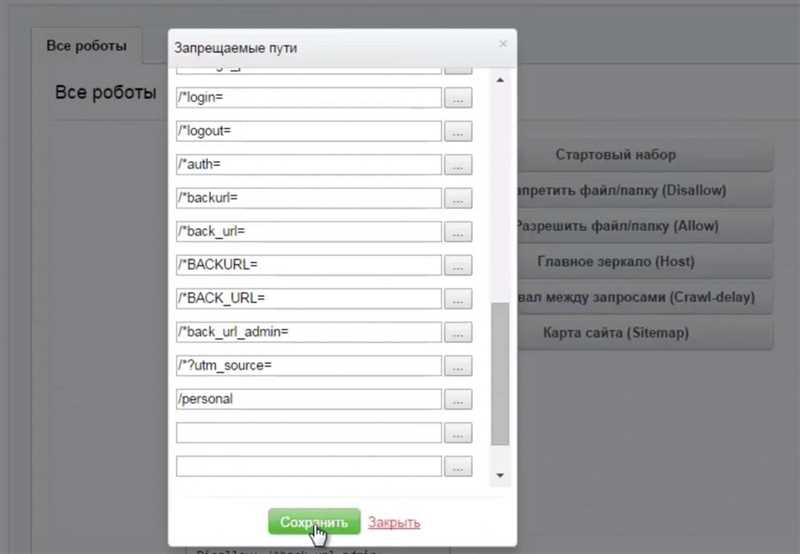

- Установка crawl-delay в robots.txt: Для использования директивы crawl-delay необходимо добавить ее в файл robots.txt вашего сайта. Синтаксис для указания crawl-delay в файле robots.txt выглядит следующим образом: «Crawl-delay: значение_задержки».

- Учет различных краулеров: Различные поисковые системы и другие краулеры могут интерпретировать директиву crawl-delay по-разному. Поэтому, для установки задержки для конкретного краулера, рекомендуется использовать указание краулера перед директивой crawl-delay, например: «User-agent: краулер», «Crawl-delay: значение_задержки».

В итоге, директива Crawl-delay предоставляет возможность управлять скоростью обхода сайта краулерами. Это важный инструмент для оптимизации производительности сайта и обеспечения защиты от несанкционированного доступа к данным. Установка оптимальных значений crawl-delay и учет особенностей различных краулеров позволят достичь наилучших результатов в использовании данной директивы.

Наши партнеры: